Als SEO ist Ihre Priorität, Ihre Website (oder die Ihres Kunden) für die Ziel-Keywords an die Spitze der organischen Suche zu bringen. Aber dafür müssen Sie wissen, wie Ihre Website aktuell performt.

Genau hier kommt der SEO-Site-Audit-Prozess ins Spiel.

Er ermöglicht, Ihre Website effektiv in ihre SEO-Kernfundamente zu zerlegen und zu identifizieren, was repariert werden muss. Richtig gemacht, sehen Sie Ihre Website mit der Zeit in den SERPs (Suchmaschinen-Ergebnisseiten) aufsteigen.

Die größte Hürde: Sie müssen Ihren Audit-Prozess so organisieren, dass Sie die wichtigsten Ranking-Faktoren effektiv analysieren – und schnellste SEO-Ergebnisse generieren.

Dieser Beitrag ist eine SEO-Audit-Checkliste, die vier kritische SEO-Bereiche im Detail aufschlüsselt. Wir besprechen, wie Sie Ihre Website in diesen Bereichen auditieren – und Probleme beheben.

Technisches SEO

In einfachen Worten: Technisches SEO macht Ihre Website für Such-Spider leichter zugänglich.

Es gibt viele Faktoren unter technischem SEO. Hier die wichtigsten für ein technisches SEO-Audit:

#1. Crawlability und Indexierbarkeit

Ihr Ziel im technischen SEO: Site für Crawling und Indexierung optimieren. Aber nur weil Such-Spider Ihre Site crawlen können, heißt das nicht, dass sie die Site in den Suchergebnissen indexieren können. Gleichzeitig heißt das nicht, dass Sie das sollten.

Beispiel: Sie haben Seiten auf Ihrer Site (AGB, Datenschutzerklärung), die Google oder andere Suchmaschinen nicht in den Ergebnissen zeigen sollen.

Abgesehen davon, dass sie keinen Mehrwert für Suchmaschinennutzer bieten, verschwenden sie auch Ihr Crawl-Budget. Das ist die Anzahl Seiten, die Google in einem bestimmten Zeitraum auf Ihrer Site crawlen kann. Wenn das Budget erschöpft ist und Ihre Site noch viele Seiten hat, crawlt die Suchmaschine erst weiter, wenn das Budget aufgefüllt ist.

In dem Fall können Sie nicht alle Seiten crawlen lassen – besonders nicht die wichtigsten. Das führt zu längerer Wartezeit, bis neue Seiten gecrawlt und indexiert werden.

Um das zu verhindern: Suchmaschinen sollen die wichtigsten Seiten zuerst crawlen. Hier einige Dinge, die Sie als Teil des Audit-Prozesses tun sollten, um die technische SEO-Performance zu verbessern:

#1A – Eine XML-Sitemap erstellen

Eine Sitemap ist eine XML-Datei mit allen wichtigen Seiten Ihrer Site. Mit einer Sitemap müssen Such-Spider nicht weit suchen – ein schneller Blick gibt ihnen die Liste aller Seiten zur Verarbeitung und Indexierung.

Die meisten Content-Management-Systeme haben eingebaute Sitemaps, die Sie in der Google Search Console oder bei Bing Webmaster einreichen können. Nach Upload erledigen die Such-Spider den Rest – sie crawlen Ihre Site nach indexierbaren Seiten.

#1B – Duplicate Content identifizieren und entfernen

Duplicate Content sind Seiten Ihrer Site mit gleichem Inhalt, aber verschiedenen URLs. Sie erzeugen Index-Bloat und erschöpfen Ihr Crawl-Budget – was korrektes Crawlen verhindert.

Ursachen für Duplicate Content:

- Seiten haben keine kanonische URL. Das erzeugt URL-Varianten, die Such-Spider verwirren – welche Version derselben URL und desselben Inhalts soll gecrawlt und indexiert werden?

- Bei WordPress-Sites: viele Tags und Kategorien für alle Seiten erstellt.

- Site liefert WWW- und Non-WWW-Versionen an Such-Spider aus.

- Site liefert HTTP- und HTTPS-Versionen aus.

Um Duplicate Content auf Ihrer Site zu finden, nutzen Sie Google-Suchoperatoren. Wenn Ihre Site Non-WWW-URLs ausliefert, suchen Sie:

site:ihre-domain.de inurl:www

Der Suchoperator zeigt, ob Google WWW-URLs Ihrer Site indexiert hat. Bei vielen Treffern haben Sie ein Duplicate-Content-Problem.

Je nach Problem braucht es eine andere Lösung. Bei WWW-URLs müssen Sie auf Non-WWW-Versionen weiterleiten – durch Konfiguration der .htaccess-Datei mit:

RewriteEngine On RewriteCond %{HTTP_HOST} ^ihre-domain.de RewriteRule ^(.*)$ http://www.ihre-domain.de/$1

#1C – Robots.txt erstellen und einrichten

Diese Datei weist Such-Spider an, welche Dateien und Ordner zu crawlen und/oder indexieren sind. Robots.txt managt Ihr Crawl-Budget – verhindert, dass Spider unnötige Seiten und Verzeichnisse crawlen. So priorisieren Spider die wichtigeren Seiten.

Beispiel: Sie können robots.txt so einrichten, dass Spider Tags und Kategorien nicht crawlen. Wenn Ihre Site noch keine robots.txt hat, erstellen Sie eine mit:

User-Agent: *

Disallow: /tag/

Disallow: /category/

Sie können Spider auch per robots.txt vom Crawlen bestimmter Seiten ausschließen. Oder ein WordPress-Plugin nutzen, das festlegt, welche Seiten Spider crawlen und indexieren dürfen. Das gibt mehr Kontrolle, welche Seiten in Suchmaschinen erscheinen.

#2 – Site-Geschwindigkeit erhöhen

Je schneller Ihre Site lädt, desto besser die Nutzererfahrung.

Das ist das Prinzip hinter Site-Speed als Ranking-Faktor seit 2018.

Kürzlich rollte Google das Page-Experience-Update aus, das Websites mit optimaler Browse-Erfahrung priorisiert. Bestimmt wird das via Core Web Vitals.

Core Web Vitals berücksichtigen neben Site-Speed:

- First Input Delay – misst die Browser-Antwortzeit auf die erste Nutzer-Interaktion beim Laden.

- Cumulative Layout Shift – unerwartete Verschiebungen von Site-Elementen (Schriften, Bilder, Videos) während des Ladens.

- Largest Contentful Paint – Zeit, bis der Hauptinhalt einer Seite geladen und interaktionsbereit ist.

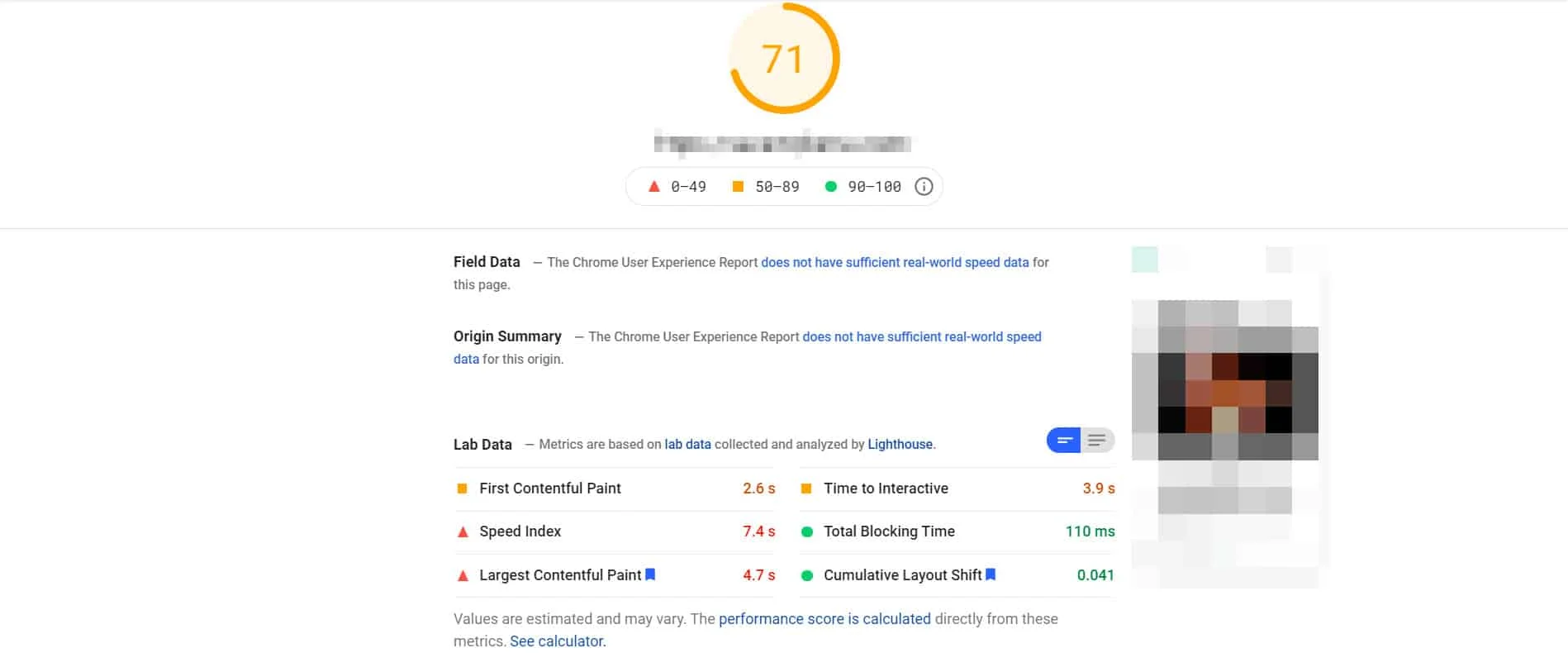

Sie können den Core-Web-Vitals-Score jeder URL via Google PageSpeed Insights berechnen.

Auf der Ergebnisseite sehen Sie genaue Probleme der Seite und Vorschläge zur Behebung.

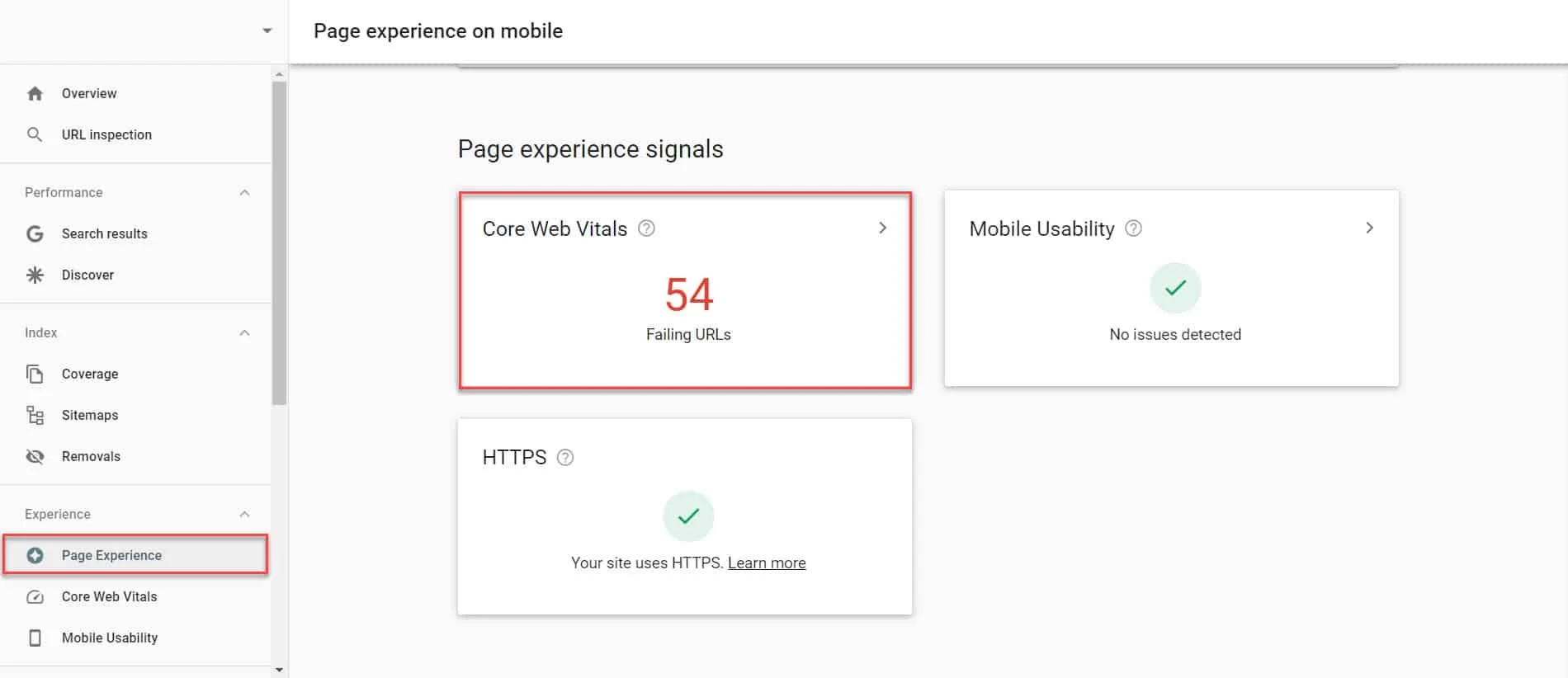

In Ihrer Google Search Console finden Sie unter dem Bereich „Erfahrung” Seiten mit niedrigen Core-Web-Vital-Scores.

#3 – Site-Struktur organisieren

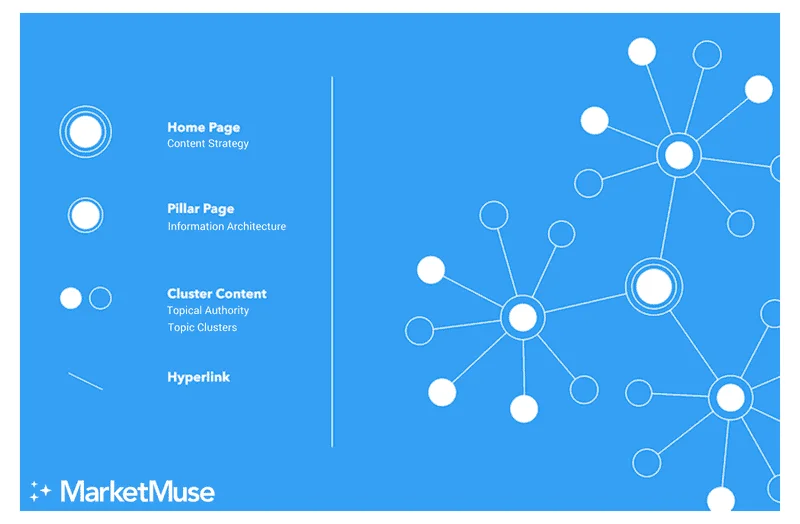

Site-Struktur bezieht sich auf die Organisation der Seiten in Silos und Cluster.

Sie können die Struktur verbessern, indem Sie Seiten mit gleichem Thema zu einem Silo gruppieren. Unter Silos können Sie Sub-Silos bilden und das Thema weiter ausbauen.

Quelle: MarketMuse

Quelle: MarketMuse

Ziel: Site-Navigation und Informationssuche so leicht wie möglich machen. Da gleichthematische Seiten zusammengefasst sind, sind Nutzer nur 1–2 Klicks von ihrer Zielseite entfernt.

Gleichzeitig helfen Sie Spidern, Seitenbeziehungen besser zu verstehen. Das erhöht die Themen-Relevanz Ihrer Site – und beeinflusst SERP-Rankings.

Der Site-Struktur-Ansatz hängt vom Site-Typ ab. Bei Blogs und Publikations-Sites ist der Prozess einfacher. Sie kategorisieren Posts und verlinken die relevantesten intern.

Schwieriger wird’s bei E-Commerce-Sites mit vielen Produkten und Kategorien. Verwandte Probleme zu siloieren ist kein Problem – aber eine flache Site-Architektur zu schaffen, ist die Herausforderung.

Idealerweise sind alle Seiten 4 Klicks oder weniger von der Homepage entfernt. Das macht das Crawlen einfacher – und verteilt Link-Authority gleichmäßig auf alle Seiten.

Auch lesen:

Was tun, wenn die Site indexiert ist, aber nicht rankt?#4 – Andere fortgeschrittene technische SEO-Faktoren beachten

Folgende fortgeschrittene Faktoren sind nicht ganz so kritisch wie die obigen, können aber langfristig den Hebel bewegen:

- Strukturierte Daten (Schema-Markup) – informiert Suchmaschinen, worum es auf Ihren Seiten geht. Suchmaschinen zeigen diese Info dann in Suchergebnissen, was die CTR steigern kann. Nutzen Sie Googles Structured-Data-Markup-Helper, um Schema für Rezepte, Produkte, Events und mehr zu erstellen.

- Mobile SEO – Google rollte 2018 Mobile-First-Indexing aus – also macht es Sinn, Ihre Website mit Mobile im Hinterkopf zu bauen. Nutzen Sie den Google Mobile-Friendly-Test, um zu sehen, ob Ihre Seiten für Mobile optimiert sind.

- Server-Logfile-Analyse – Prozess zum Review einer Datei mit allen HTTP-Anfragen an Ihren Webserver. Liefert Insights zu Crawl-Budget, Zugänglichkeitsproblemen, Crawl-Frequenz und mehr. Sie können das Logfile via Apache (Linux) oder IIS (Windows) analysieren.

On-Page-SEO

Mit dem technischen SEO im Griff geht’s an On-Page. Hier optimieren Sie Seiten für ihre Ziel-Keywords. Dafür müssen Sie das Keyword in den On-Page-Elementen unterbringen, die als Ranking-Faktor am stärksten wiegen.

Hier die Elemente, in denen das Keyword zwingend vorkommen muss:

#5 – Keyword im Seitentitel

Der Seitentitel sagt Nutzern und Suchmaschinen, worum es auf der Seite geht. Er steht im Title-Tag und ist das Erste, was Nutzer in den Suchergebnissen sehen.

Es geht also nicht nur ums Reinpacken – Sie müssen einen Titel schreiben, den Nutzer in den SERPs anklicken wollen.

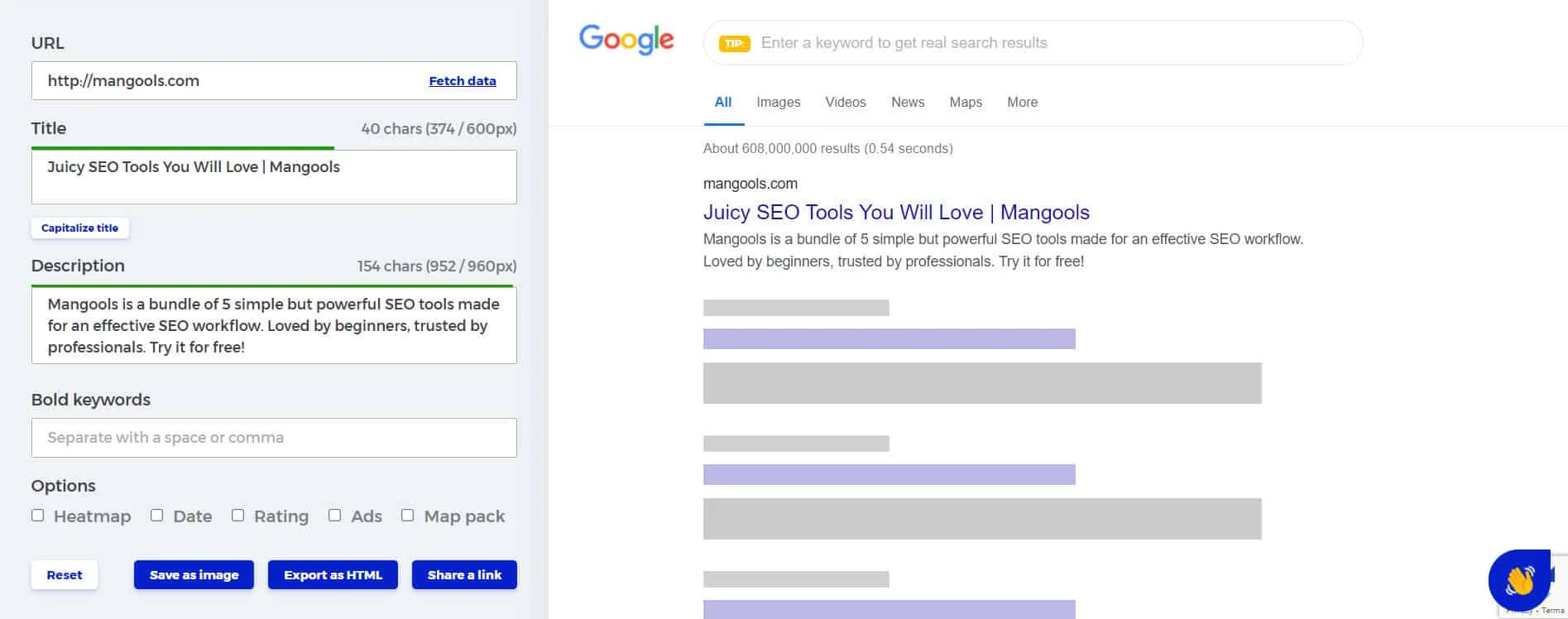

Ein weiterer Faktor: Länge. Bei zu langem Titel schneidet Google ab – Nutzer sehen nicht den ganzen Titel, was die CTR senken kann.

Damit der Titel auf Google-SERPs vollständig erscheint, nutzen Sie Mangools’ Google SERP-Simulator.

Er sagt Ihnen, ob Titel und Meta-Descriptions zu lang sind – damit Sie kürzen oder anpassen können.

#6 – Keyword in der Überschrift

Sie müssen das Keyword auch in der Überschrift erwähnen – besonders im H1-Tag, der ein riesiger Ranking-Faktor ist.

Anders als der Title-Tag erscheint der H1-Tag erst nach dem Klick aus den Suchergebnissen.

Es ist möglich, dass H1- und Title-Tag identisch sind – aber besser sind unterschiedliche Versionen. Title-Tag soll zum Klicken animieren, H1 beschreibt, was Nutzer beim Lesen erwartet.

#7 – Keyword in der URL

Die URL rundet die „drei Könige des On-Page-SEO” ab – mit Title und H1.

Das Keyword hier hilft Such-Spidern zu verstehen, worum es geht. Sie ranken dann höher in der organischen Suche, einfach durch Einbinden der Ziel-Keywords in diese Elemente.

#8 – Bilder optimieren

Erwähnen Sie das Keyword im Alt-Text – aber nur wo passend. Setzen Sie es nicht in alle Bild-Alts, das wirkt für Google spammy.

Komprimieren Sie zudem Bilder – kleinere Dateigrößen ohne Qualitätsverlust.

Sites mit vielen Bildern laden langsamer als Sites ohne. Da Site-Speed als Ranking-Faktor an Bedeutung gewinnt, riskiert Ihre Site Ranking-Verluste.

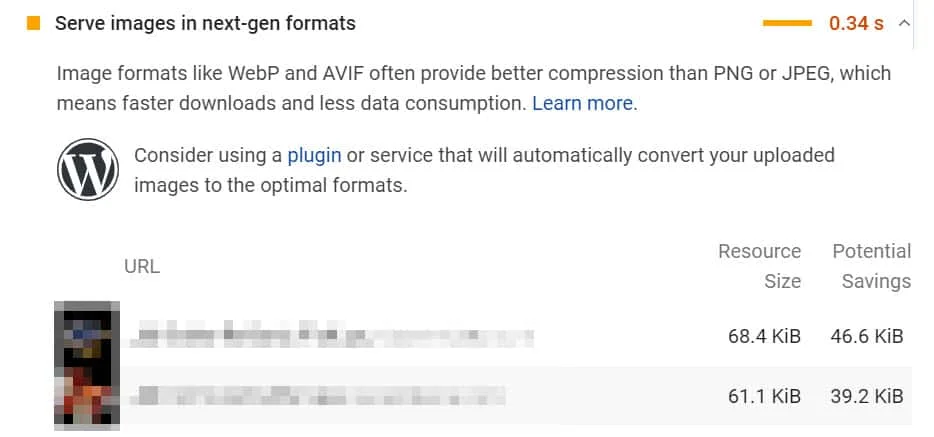

Eine Page-Analyse via Google PageSpeed Insights zeigt, welche Bilder zu optimieren sind.

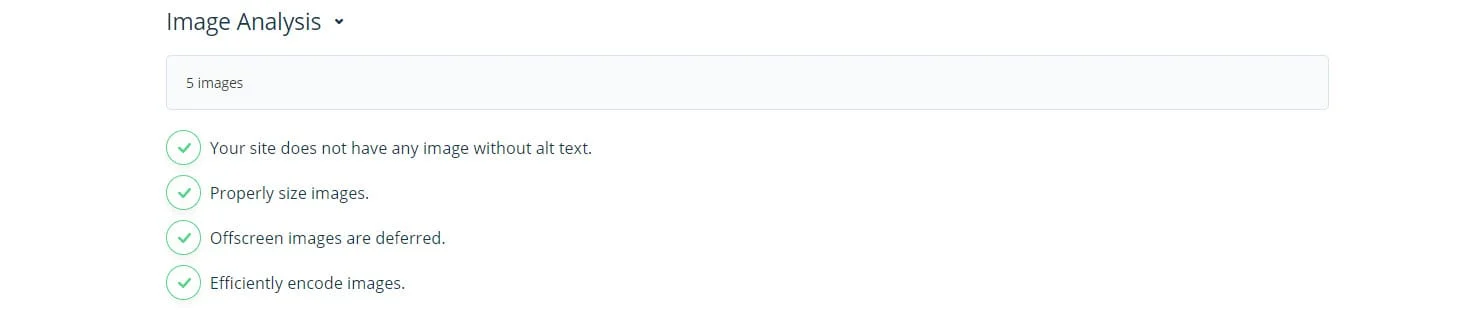

Ein weiteres Tool: SiteAuditor.com. Es zeigt, ob Ihre Bilder Best Practices der On-Page-Optimierung folgen.

WordPress-Plugins wie ShortPixel komprimieren nicht nur neue Uploads, sondern auch bestehende. Kein Re-Upload nötig – Bulk-Optimierung direkt auf der Site.

#9 – Interne Links bauen

Interne Links sind Links von Seiten Ihrer Site auf andere Seiten Ihrer Site. Sie helfen, Site-Struktur zu bauen – besonders Content-Silos.

Neben der XML-Sitemap helfen interne Links Such-Spidern, neue zu crawlende Seiten zu finden. Wenn Sie also einen frischen Blogpost veröffentlichen, hilft das Verlinken aus verwandten Seiten, dass der Post schneller in der Google-Suche erscheint.

Beim Auditieren interner Links ist es wichtig, gleichthematische Seiten zu verbinden. Vermeiden Sie das Verlinken nicht verwandter Seiten – das ergibt für Leser und Spider keinen Sinn.

Über interne Links können Sie auch Seiten aufspüren, die keine internen Links haben. Diese „verwaisten Seiten” ranken nicht hoch oder gar nicht. Finden Sie verwandte Seiten, die auf die verwaisten verlinken können.

Schließlich: Sie könnten gebrochene interne Links haben, falls Sie URLs alter Posts geändert haben. Identifizieren Sie diese – und ersetzen Sie durch korrekte URLs.

Link Whisper ist ein WordPress-Plugin zum Finden gebrochener Links und verwaister Seiten – um On-Page-SEO zu verbessern.

Content

Anders als On-Page-SEO bezieht sich Content-Audit auf die Bewertung der Nützlichkeit einer Site.

Statt einer Checkliste zu folgen, erfordert der Prozess qualitative Analyse, ob ein Content-Stück Nutzer und Suchmaschinen befriedigt. Erfolg hängt davon ab, was Sie als großartigen Content erkennen.

Faktoren für den Content-Audit:

#10 – Content erfüllt Suchintention der Seite

Sie können Keywords in drei Gruppen kategorisieren:

- Navigational – Nutzer wollen eine Webseite einer Marke finden, z. B. samsung j7.

- Informational – Nutzer wollen mehr über ein Thema lernen, z. B. „was ist ein Fragment in Android”.

- Commercial/Transactional – Nutzer recherchieren oder wollen kaufen, z. B. „bester Desktop-PC für Online-Unterricht”, „Bungalow zum Verkauf”.

Jede Suchintention beantwortet eine spezifische Frage.

Bei „bester Desktop-PC für Online-Unterricht” sollten Sie keine generellen Infos zu Desktop-PCs liefern. Listen Sie passende Computer für Online-Unterricht auf, mit Specs, Pro und Contra. So treffen Leser eine informierte Kaufentscheidung.

Beim Content-Review: Stellen Sie sicher, dass Content zur Suchintention des optimierten Keywords passt. Wenn nicht, müssen Sie überarbeiten.

#11 – Lesbarkeit verbessern

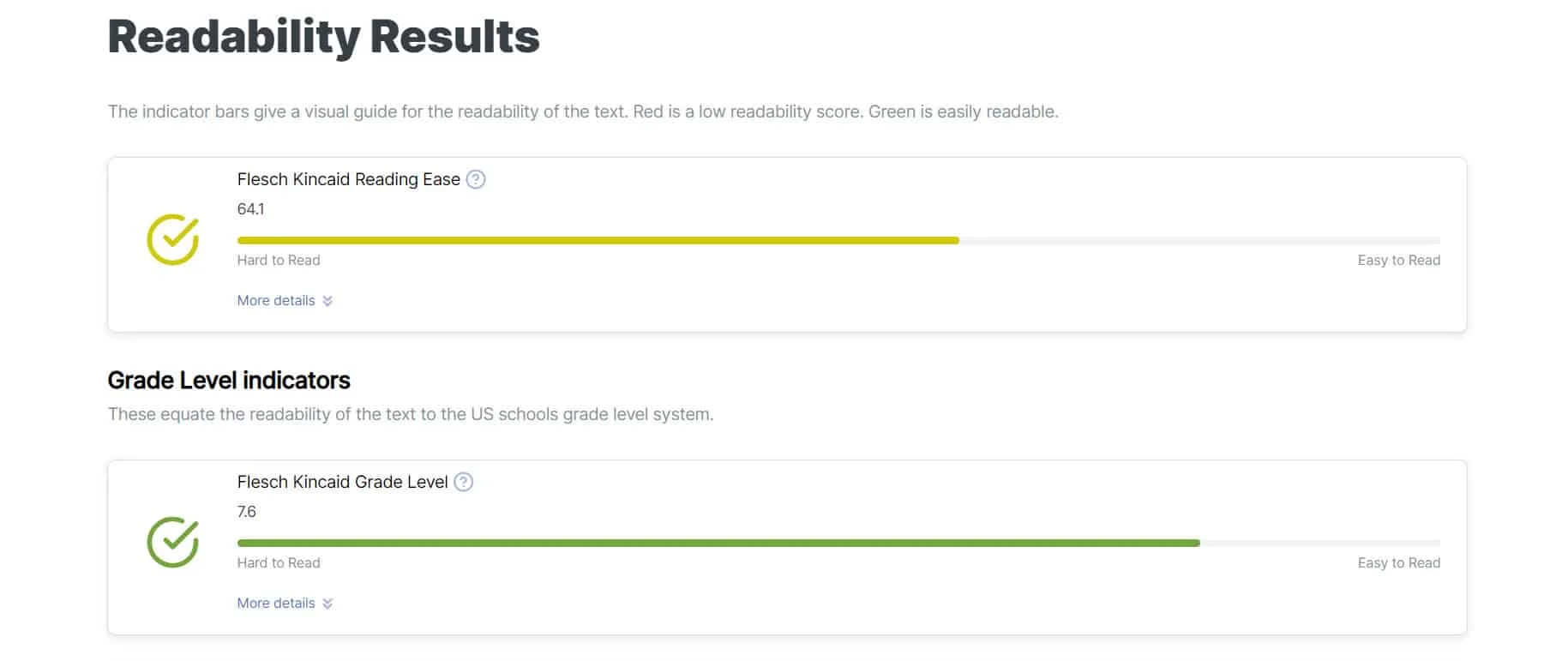

Je höher der Lesbarkeits-Score, desto leichter verstehen Leser den Content.

Manche Branchen erfordern Fachjargon, der den Score senkt. Finden Sie Wege, den Score zu erhöhen, ohne die Botschaft zu verwässern. Wichtiger: Ihre Kern-Audience versteht den Content.

Sie können den Score auditieren, indem Sie Text in ein Tool wie WebFX’ Readability-Test kopieren.

Es berechnet verschiedene Grade-Level-Indikatoren wie Flesch-Kincaid, Gunning Fog und mehr.

#12 – Thin Content fixen

Thin Content sind Seiten ohne Mehrwert für Leser. Typisch durch geringe Länge – aber Wortzahl ist nicht der einzige Faktor.

Reviewen Sie Content nach Wortzahl. Wahrscheinlich müssen Sie editieren und mehr Info liefern, um den Content für die Audience nützlicher zu machen.

WP Word Count ist ein Plugin, um Wortzahlen aller Content-Stücke zu tracken. Sie können einzelne Stücke prüfen und sehen, ob welche aufgestockt werden müssen.

#13 – Duplicate Content eliminieren

Wenn Sie denselben Textblock auf verschiedenen Seiten Ihrer Site nutzen, kann Google diese als Duplicate Content flaggen. Tritt oft auf, wenn Gastposts plagiierten Inhalt einreichen.

Bei fragwürdigen Seiten: Text in Copyscape kopieren und prüfen, ob der Inhalt schon einmal veröffentlicht wurde – auf Ihrer oder anderer Site.

#14 – E-A-T konsequent beachten

E-A-T tauchte erstmals in Googles 168-seitigem Search-Quality-Raters-Guidelines-Dokument auf. Steht für Expertise, Authority, Trustworthiness.

Quelle: Google

Wenn eine Site Content veröffentlicht, muss der Autor die Credentials als Subject-Matter-Expert haben.

E-A-T ist offiziell kein Ranking-Faktor – wird aber im Medic Update stark referenziert, das viele schwache YMYL-Sites (Your Money, Your Life) abstürzen ließ.

Beim Prüfen, ob Ihr Content E-A-T-Prinzipien folgt, beantworten Sie:

- Ist der Autor qualifiziert, über das Thema zu schreiben?

- Sind die Infos akkurat und aktuell?

- Würden vertrauenswürdige Sites auf Ihren Content verlinken?

- Haben Sie Content mit Author-, Organization- und Article-Schema markiert?

So schaffen Sie den bestmöglichen Content für Ihre Website.

#15 – Keyword-Kannibalisierung

Idealerweise zielt nur eine Seite auf ein bestimmtes Keyword. Aber es kann passieren, dass eine andere Seite dafür rankt – und unbeabsichtigt höher als die intendierte.

Diese Keyword-Kannibalisierung kann Ihre SEO-Kampagne schädigen. Sie verwässert die Autorität der intendierten Seite, da sie organischen Traffic mit einer Seite teilt, die nicht ranken sollte.

Mit einem Rank-Tracking-Tool sehen Sie, wo Kannibalisierung auftritt. Wenn das passiert: beide Seiten zusammenführen oder die unerwünschte URL auf die gewünschte weiterleiten – damit alle Autorität einhereinläuft.

Off-Page

Off-Page-SEO – meist Linkbuilding genannt – bezieht sich auf Ihr Linkprofil. Ziel: Backlinks von autoritativen Seiten relevant zu Ihrer Nische.

„Off-Page” bedeutet aber: Sie haben wenig Kontrolle über Links, die mit der Zeit entstehen. Während Sie eigene Linkbuilding-Kampagnen fahren können, kommen auch Links rein, die SEO schaden.

Um das zu vermeiden, auditieren Sie Ihre Links so:

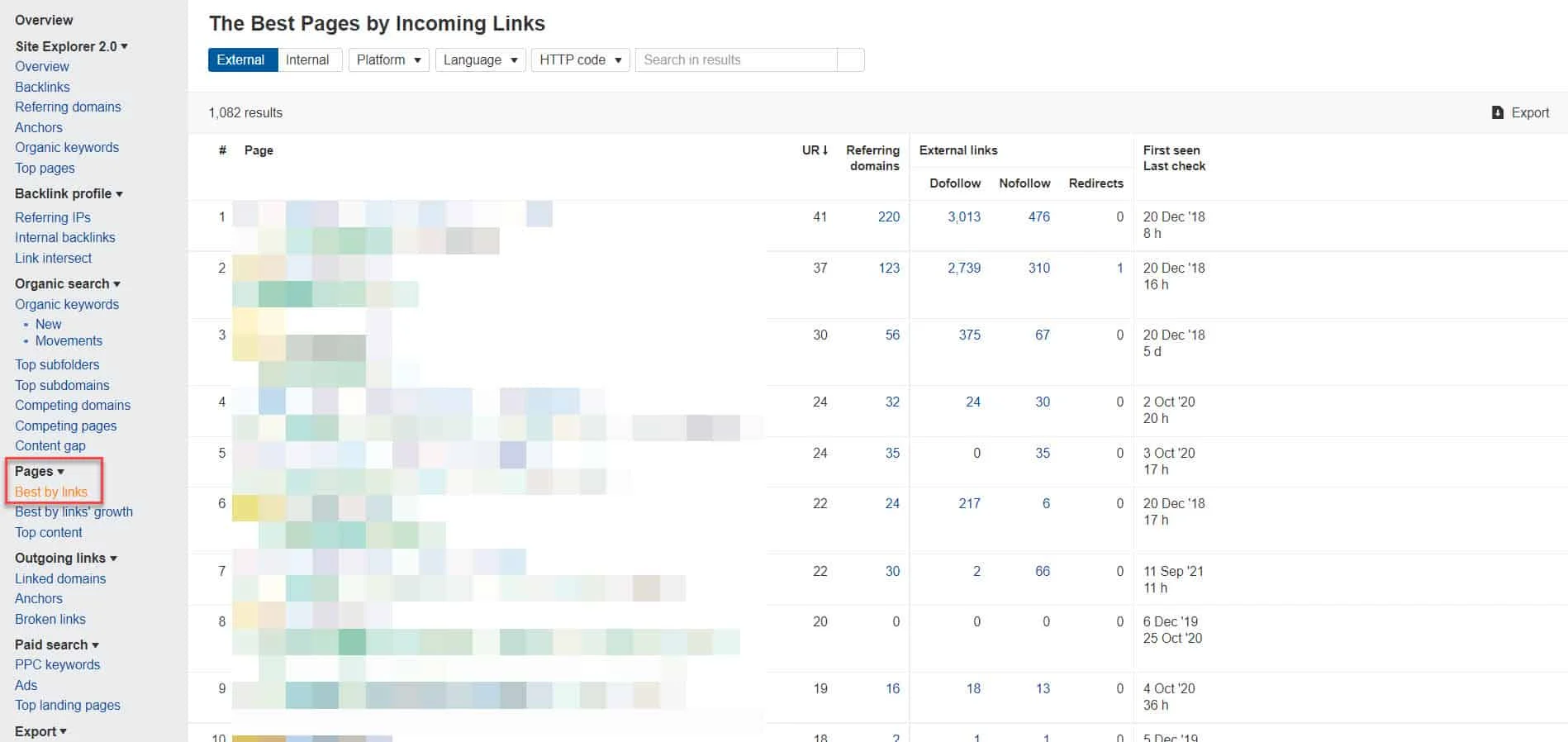

#16 – Top-verlinkte Seiten identifizieren

Seiten Ihrer Site mit den meisten Domain-Links haben Content mit Audience-Wert. Es liegt in Ihrem Interesse, diese Links zu tracken und nicht zu verlieren.

Welche Seiten das sind, finden Sie via Ahrefs.

Wahrscheinlich ranken diese Seiten hoch für ihre Keywords und treiben den meisten Traffic in Google Analytics. Monitoren Sie das Ranking. Wenn es abrutscht, haben Sie womöglich Links verloren – oder müssen Content updaten.

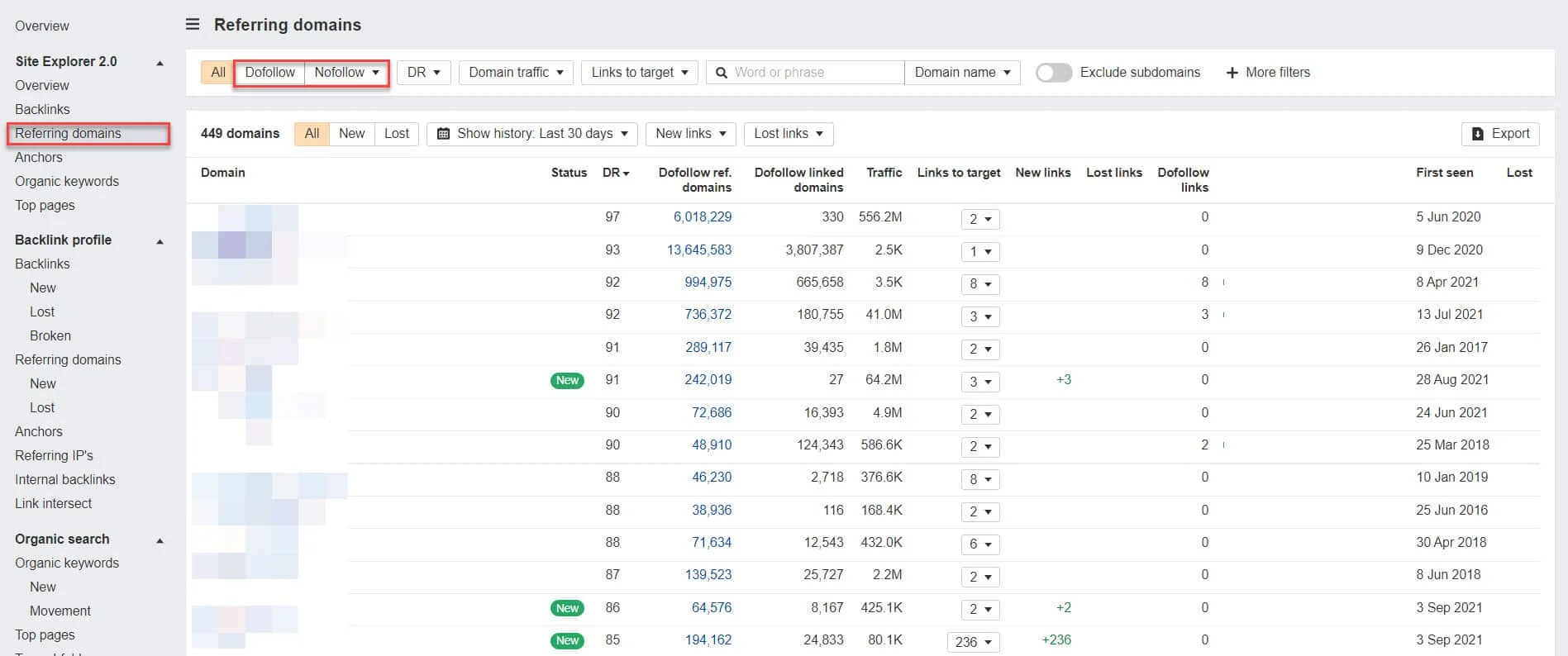

#17 – Gesundes Verhältnis zwischen Nofollow- und Dofollow-Links

Idealerweise wollen Sie viele Dofollow-Backlinks von hochwertigen Sites. Dieser Backlink-Typ leitet Autorität weiter – und führt zu höheren SERP-Rankings.

Bei Nofollow-Backlinks gilt das nicht. Sie übertragen keine Autorität, egal wie viele Sie von autoritativen Sites bekommen.

Das heißt aber nicht, Nofollow-Links zu ignorieren. Ein natürlich aussehendes Linkprofil hat einen gesunden Mix.

Während Dofollow-Backlinks der Schlüssel zu höheren Rankings sind, gehen Sie nicht aus dem Weg, ausschließlich Dofollow zu bauen.

Prüfen Sie Linktypen mit Tools wie Ahrefs.

Vielleicht hält Sie das Übergewicht an Dofollow-Links zurück. Bauen Sie dann mehr Nofollow, damit das Profil natürlicher wirkt.

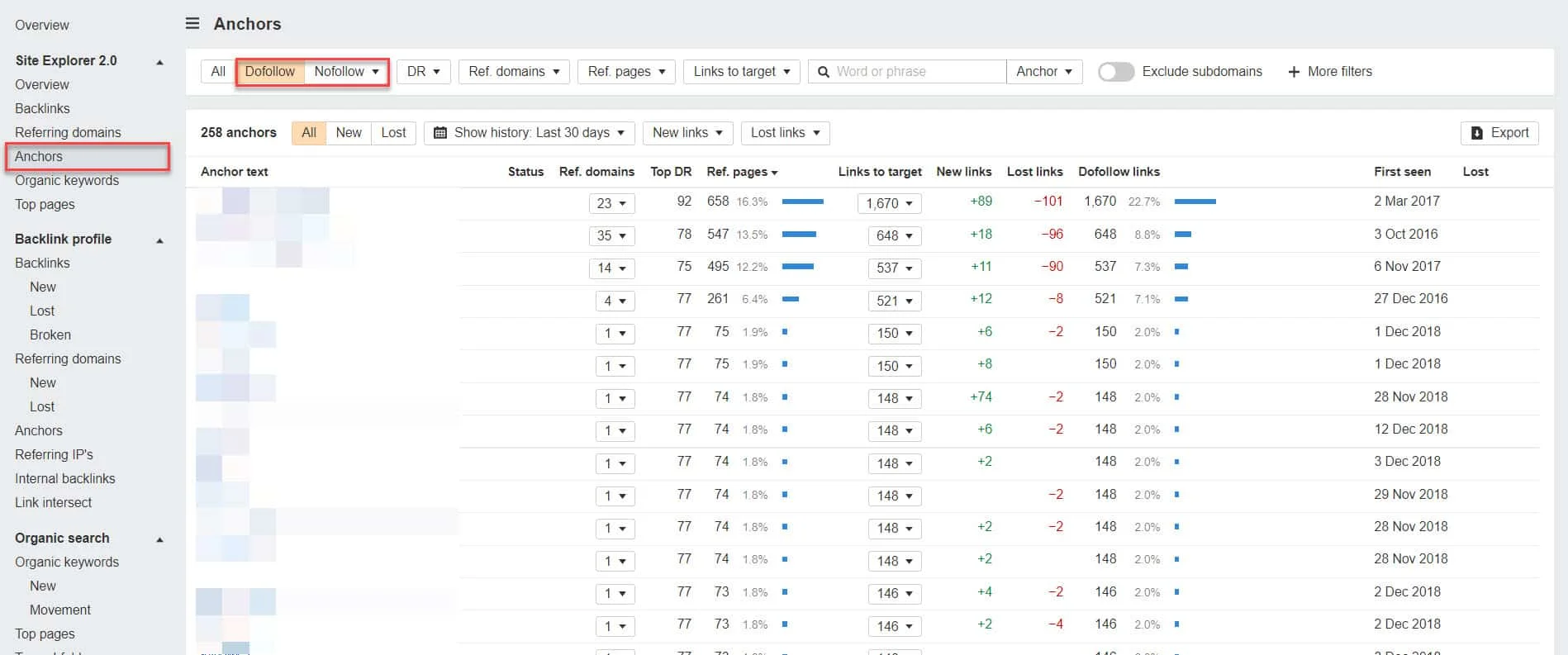

#18 – Anchor-Text

Es gibt verschiedene Anchor-Text-Typen für Links auf Ihre Site:

- Exact Match – nutzt das Ziel-Keyword als Anchor, z. B. „beste Bluetooth-Lautsprecher” für das gleichnamige Keyword.

- Partial Match – nutzt Wörter aus dem Ziel-Keyword, z. B. „Bluetooth-Lautsprecher zum Nutzen”.

- Naked – nutzt die URL als Anchor, z. B. „pageurl.com”.

- Branded – nutzt den Site-Namen, z. B. „Page URL”.

- Generic – nutzt allgemeine Phrasen wie „klicken Sie hier”, „zur Seite”.

Idealerweise wollen Sie viele Exact-Match-Anchors für Backlinks – um den Effekt zu verstärken und höher zu ranken.

Aber wie bei Backlink-Typen: natürlich wirkende, kontextuelle Anchors lassen Ihre Site nicht hervorstechen.

Das ideale Verhältnis ist Case-by-Case. Prüfen Sie Anchors auf Ihrer Site mit Ahrefs und klassifizieren die häufigsten.

Wenn die Mehrheit Partial-Match und Naked sind, nutzen Sie diese stärker in der nächsten Kampagne.

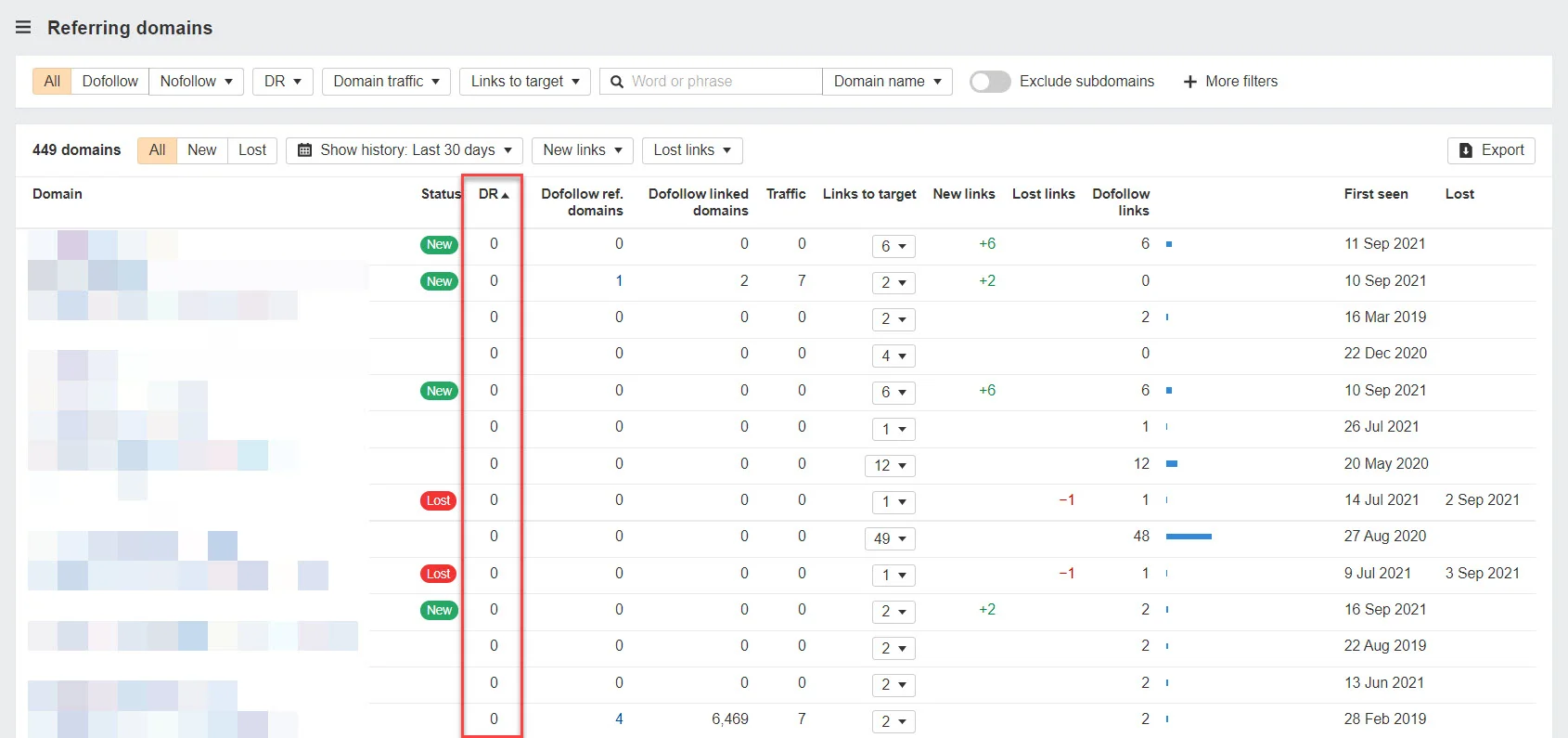

#19 – Low-Quality-Backlinks identifizieren

Wie erwähnt, können spammy Backlinks Such-Rankings beeinflussen. Google ist smarter geworden und ignoriert Low-Quality-Links – Sie sollten aber wachsam sein, ob diese Links Ihre Rankings negativ beeinflussen.

Mit Ahrefs finden Sie Low-Quality-Links, indem Sie verweisende Domains nach Domain-Authority (DA) aufsteigend sortieren. DA ist die Metrik von Ahrefs zur Site-Autorität.

Eine Domain mit niedrigem DA bedeutet entweder neue oder qualitativ schwache Site. Diese Links erstmal ignorieren – außer sie korrelieren mit einem Ranking-Drop. Erst dann disavowen Sie, um Rankings wiederherzustellen.

#20 – Gebrochene Links finden und zurückgewinnen

Ein Ranking-Drop kann auch mit verlorenen Backlinks korrelieren. Passiert, wenn der Owner der autoritativen Site den Link manuell entfernt, die Seite löscht oder die Site komplett offline nimmt.

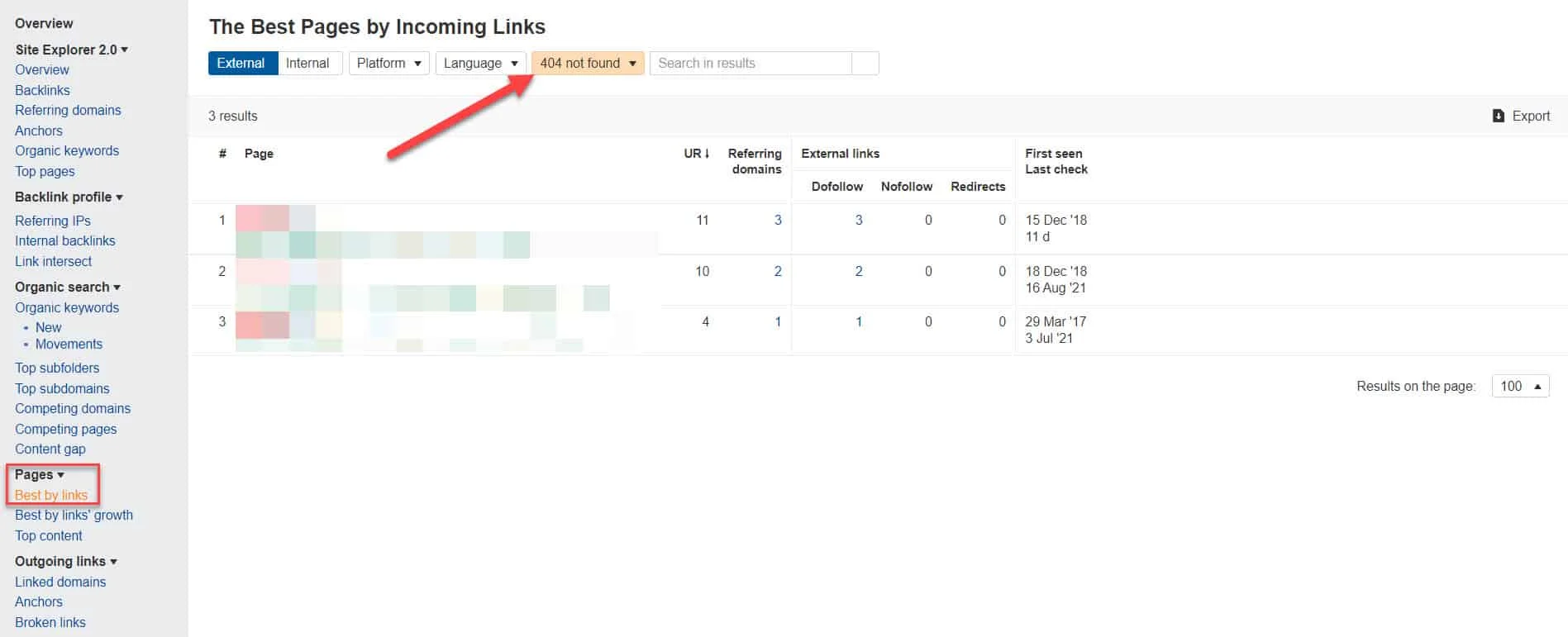

Um gebrochene Backlinks zu sehen: Gehen Sie zu Pages > Best by links und filtern auf 404 not found.

Wenn die Site noch existiert: Outreach machen, Backlink zurückgewinnen. Höflich fragen, warum der Link entfernt wurde – und was nötig ist, um ihn wiederherzustellen.

Fazit

Es gehört viel dazu, Websites an die Spitze von Suchmaschinen zu bringen – ein SEO-Audit spielt eine entscheidende Rolle. Wenn Sie die aktuelle Performance verstehen und wissen, was zu verbessern ist, skalieren Sie SEO-Erfolg konstant.

SEO-Audits können mühsam sein ohne Tools wie Ahrefs und SiteAuditor.com. Fokussieren Sie dann darauf, Probleme zu fixen – und das Ranking schrittweise zu verbessern.