Jenseits von Keywords: Wie SEOs 2026 für KI-Such-Prompts optimieren

Die Ära der Jagd auf einzelne Keywords ist vorbei.

Ihr Content muss semantisch relevant über eine Bandbreite verborgener Fan-out-Anfragen sein. Anders gesagt: Sie müssen ein Thema so gut abdecken, dass es egal ist, wie jemand fragt – die Antwort führt trotzdem zu Ihnen.

Die Kollegen von iPullRank, einer Content-Marketing- und Enterprise-SEO-Agentur, nennen diesen Prozess „Relevance Engineering”. Es ist die Praxis, Ihren Content quantifizierbar auffindbar, abrufbar und nützlich über alle Such- und KI-Empfehlungssysteme hinweg zu machen.

Klingt anspruchsvoll? Ist es auch.

Es ist teils Mathematik, teils Wissenschaft, teils Systemdenken. Wir starten aber mit dem Teil, den jeder anfassen kann: Content-Optimierung. Oder wie sie es nennen: Content-Engineering.

Der Wechsel von SEO-Keywords zu KI-Such-Prompts

Klassisches SEO hat uns gelehrt, Keywords als das anzuvisieren, was sie waren: spezifische, exakte Phrasen, die Nutzer in eine Suchleiste tippen. Mit KI-Suche entwickelt sich dieser statische Input zu etwas Dynamischerem: Prompts.

Nutzer suchen nicht mehr, sie unterhalten sich.

Statt „SEO-Tools” zu tippen, fragen sie: „Welches SEO-Tool eignet sich am besten, um lokale Rankings mit 200 $ Budget zu tracken?” oder „Soll ich Keyword.com oder BrightLocal nutzen, wenn ich gerade eine Agentur starte?”.

Das ist ein vollwertiger Prompt. Mehr Kontext, mehr Intention – und mehr Wege, die Antwort zu verfehlen, wenn Ihr Content nicht sitzt.

Der Unterschied? Prompts sind nuanciert; menschlicher. Und KI-Modelle sind darauf trainiert, vorherzusagen, was die nützlichste Antwort ist – nicht nur, eine Phrase zu matchen (dazu gleich mehr).

Eine Gegenüberstellung der Unterschiede:

| Keyword-Optimierung | Prompt-basierte Optimierung |

|---|---|

| Fokus auf Keywords und spezifische Phrasen. | Fokus auf breite Themen und natürliche Sprachmuster. |

| Statische Nutzerintention. | Dynamische, geschichtete Intention hinter jeder Anfrage. |

| Optimiert für SERPs. | Optimiert für KI-generierte Antworten, Markenerwähnungen und Zitate. |

| Gewinnen durch Ranking in den SERPs. | Gewinnen, indem KI-Algorithmen Sie referenzieren, zitieren oder zusammenfassen. |

| Fokus auf Volumen und Wettbewerb. | Fokus auf Kontext, Abdeckung und Auffindbarkeit. |

Warum ist der Wechsel zu KI-Suche wichtig?

Weil es nun genug Signale (subtil und offen) gibt, dass KI-Suche die Zukunft ist.

Vom ChatGPT-Release Ende 2022, der eine Welle weiterer LLM-Chatbots auslöste, über Googles Veröffentlichung von AI Overviews (zuvor SGE) 2024 bis zur Ankündigung des Google AI Mode auf der Google I/O 2025: „Google bereitet sich darauf vor, die klassische Suchergebnisseite durch ein konversationelles, personalisiertes, KI-gestütztes Erlebnis zu ersetzen”, sagt Gianluca Fiorelli, International SEO Consultant, in seinem Artikel für iloveSEO.

Auch wenn KI- und LLM-gestützte Systeme noch in der Entwicklung sind, prägen sie bereits Recherche, Kaufentscheidungen und die Art, wie Nutzer berufliche Aufgaben angehen. Wenn Sie in dieser KI-Such-Ära relevant bleiben wollen, denken Sie über Keywords hinaus und optimieren Sie für semantische Klarheit und echte Insights.

Wie? Tauchen wir in die Taktiken ein, die aktuell funktionieren.

So sorgen Sie dafür, dass Ihr Content von KI-Such-Prompts aufgegriffen wird

1. Bauen Sie eine semantische Content-Architektur

Generative KI liest oder versteht Content nicht wie wir. Sie sagt Antworten voraus, die ihr „richtig klingen” – basierend auf Mustern, Beziehungen und Faktenwissen, das nicht zwingend an einen bestimmten Content gebunden ist.

Sie verlassen sich auf:

- Die großen Datensätze, mit denen das KI-Modell trainiert wurde. Das Modell lernt die inhärenten Muster und die Struktur dieses Datensatzes, um neue Information zu generieren. Laut OpenAI (frei wiedergegeben): „Große Datensätze ermöglichen es Modellen, vielfältige Muster zu lernen und realistischere, abwechslungsreichere Outputs zu erzeugen.”

Bei einem Prompt, der Information aus diesen Trainingsdaten erfordert, sagt das System mögliche Antworten anhand statistisch wahrscheinlicher Optionen voraus.

Das heißt: Es nähert sich der Antwortgenerierung mit Wahrscheinlichkeiten aus verschiedenen Perspektiven. Deshalb klingt es klug, ist aber inhärent unzuverlässig – die Antworten sind probabilistisch.

- Retrieval Augmented Generation (RAG). Dieses System holt sich in Echtzeit Stützinformation aus relevantem Long-Tail-Content tief in Ihrer Site.

Site- und Content-Architektur sind also nicht nur fürs Ranking hilfreich, sondern essenziell, um in KI-generierten Antworten gefunden und zitiert zu werden.

Die Frage: Wie strukturieren Sie Ihren faktentreuen Content, damit LLMs ihn in RAG- und Trainingsdaten zugänglich machen können?

Erstellen Sie semantisch relevanten Content

Das heißt: Schreiben Sie so, dass nicht nur Ihr Hauptthema, sondern auch alle verwandten Ideen, Konzepte und der Kontext klar zum Ausdruck kommen.

Auf hoher Ebene bedeutet das, zunächst eine lesbare und logische Struktur des sichtbaren Contents sicherzustellen. Das umfasst alle bekannten On-Page-SEO-und-UX-Aspekte, mit denen Nutzer und KI-Suchmaschinen Content leicht finden und verstehen:

Klare hierarchische Überschriften: Strukturieren Sie Content mit H1-, H2-, H3- und (falls nötig) H4-Tags. Das H1 ist das Hauptthema; H2 bis H4 unterteilen es in lesbare Abschnitte, die Skim-Lesen und Verstehen erleichtern.

Semantische Sektionen, knappe Absätze und direkte Antworten: Zerlegen Sie Content in semantische Einheiten. Das macht es KI-Algorithmen leichter, die relevantesten Passagen aus Ihrem Content abzurufen.

Dazu passt das Aufteilen in klar definierte Unterthemen. Jeder Abschnitt sollte kurze, präzise Absätze mit den wichtigsten Informationen vorne haben – eine Idee oder ein Konzept pro Absatz. Jeder Absatz sollte klare, spezifische, überzeugende Sätze haben – idealerweise zwei bis drei pro Absatz.

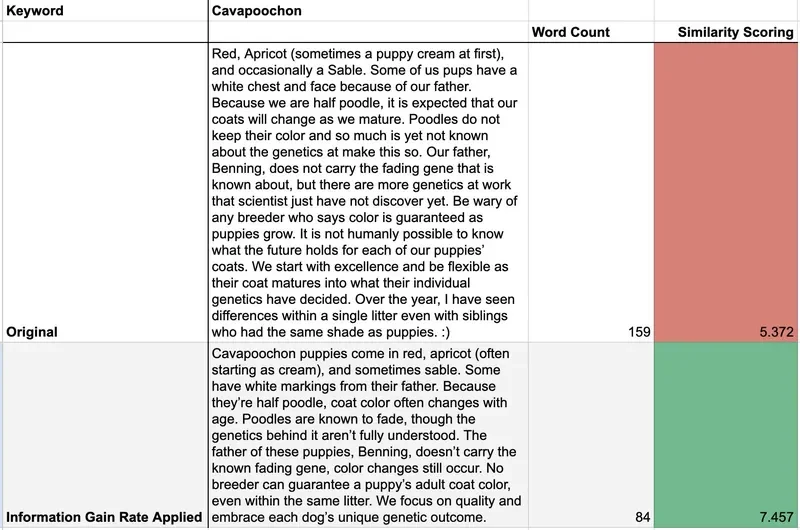

In einer Untersuchung von Go Fish Digital wurde ein Absatz aus einem auf Position 2 rankenden Artikel umgeschrieben, sodass er:

- Eine kürzere Struktur hatte.

- Klarere Sätze hatte.

- Dieselben Fakten enthielt.

Die optimierte Version wurde in Googles AI Overviews aufgenommen, „weil sie sich daran orientiert, wie Sprachmodelle High-Confidence-Antworten erkennen: dichte Information, simpel strukturiert und leicht zu zitieren”, sagt Dan Hickley, Co-Founder.

Im Kern: Klarer Content steigert Lesbarkeit und konkurriert auf Passagen-Ebene mit fragmentierten Content-Stücken, die in AI Overviews landen, in den AI Mode und in LLMs wie Perplexity.

Bullet Points und nummerierte Listen: Wie Überschriften helfen Bullets und Listen Nutzern, Content leicht zu scannen und zu verarbeiten. KI-Modelle können Schlüsselpunkte so leichter zusammenfassen.

Klare Beziehungsmuster: Wenn Sie Long-Form-Content schreiben, der mehrere Ideen verbindet, strukturieren Sie Sätze so, dass die Beziehung sichtbar wird.

Statt vage oder komplexer Sprache nutzen Sie klare „Wer-tut-was”-Aussagen, die zeigen, was passiert, wer beteiligt ist und welche (potenziellen) Ergebnisse folgen. Technisch heißt das semantisches Tripel: Subjekt → Verb → Objekt.

Beispiel:

Sagen Sie nicht: „Es gibt Vorteile, die mit der Implementierung dieser Optimierungsstrategien verbunden sind.”

Sagen Sie: „Wenn Agenturen Kunden-Content für KI-Suche optimieren, sehen sie 40 % mehr Markenerwähnungen und können Premium-Preise für ihre Expertise verlangen.”

Das hebt die semantische Klarheit – KI-Suchmodelle holen und zitieren Ihren Content präziser.

Bauen Sie Topic Cluster und robuste interne Verlinkung

Wenn Sie Content-Optimierung für KI an der Oberfläche bewältigt haben, gehen Sie in die Tiefe. Hier kommt das Clustern Ihres Contents um Themen rund um Ihr Hauptthema ins Spiel.

Logisches Verlinken verwandter Seiten mit beschreibenden Anchor-Texten baut eine semantische Karte für Ihre Website. Indem Sie Content publizieren, der unterschiedliche, aber verwandte Facetten eines Kernthemas tief behandelt, bauen Sie thematische Autorität auf und signalisieren Nutzern wie KI-Algorithmen Ihre Expertise.

Tieferer Content erlaubt es zudem, kritische Pain Points einer Customer Journey anzusprechen, die KI-Such-Modelle als Antwort auf personalisierte Prompts abrufen.

Dieses „Personalisierungs”-Element ist entscheidend für KI- und LLM-Discovery, da diese Modelle externe Quellen aus Content ziehen, der originell, relevant und eng mit einem Thema verknüpft ist.

Austin Mitchells Kommentar zu einem Post auf LinkedIn bringt es auf den Punkt:

„Hyper-Personalisierung verlangt tiefe Kundenkenntnis, Segmentierung und Content, der die gesamte Customer Journey abdeckt. Ich vermute, dass eine Website, die einen großen, komplexen Prozess in einem sehr bestimmten Umfeld Schritt für Schritt erklärt (etwa SIEM-Implementierung für ein EU-Healthcare-Startup, das von einer Open-Source-Lösung migriert), sehr gut abschneiden wird. Je tiefer und situativer, desto besser.”

2. Setzen Sie auf multimodalen Content

Content gibt es in vielen Formaten. Eine Mischung dieser Formate in Blog-Posts oder Webseiten sorgt für ein reicheres, manchmal interaktives Nutzererlebnis.

Klassische Suchmaschinen wie Google und Bing zeigen seit jeher (auch vor der KI-Ära) eine Mischung aus Bildern, Videos und Text in den Suchergebnissen. Es ist nur logisch, dass weiterentwickelte Suchtechnologien wie LLMs und Googles AI Mode diese Content-Vielfalt unterstützen, um verschiedene Intentionen zu bedienen.

Damit Ihr Content also von KI-Such-Algorithmen aufgegriffen wird, ist wie Sie Information präsentieren, ebenso wichtig wie was Sie sagen.

Wie sieht multimodaler Content aus?

- Videos, die Ihr Produkt erklären oder Ihr Tool in Aktion zeigen.

- Diagramme und Charts, die Kernkonzepte visualisieren.

- Checklisten und Vergleichstabellen, die komplexe Information zerlegen.

- Eingebettete Tweets, Audioclips oder Slides.

Beispiel: Eine Produkt-Tutorial-Seite mit einem kurzen Erklärvideo, einer Bullet-Liste mit Vorteilen und einer Vergleichstabelle, die Ihr Tool gegenüber Wettbewerbern positioniert.

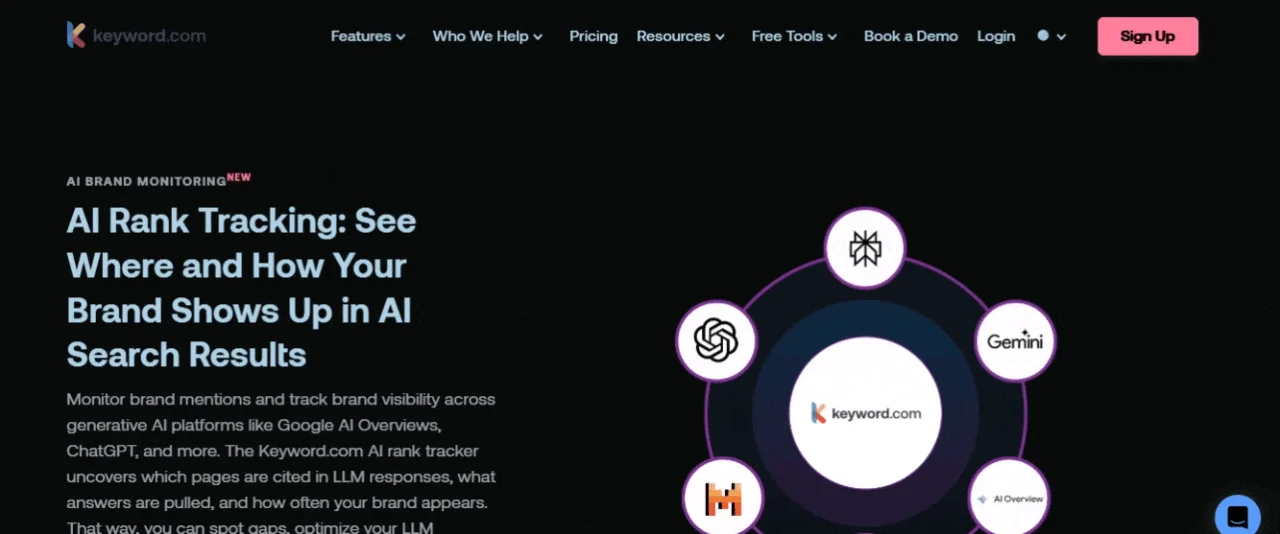

Ein gutes Beispiel ist unsere AI-Search-Visibility-Produktseite. Sie kombiniert Erklärvideo, interaktive Visualisierungen und annotierte UI-Screenshots, um die Produktfunktionen von Keyword.com in unterschiedlichen Lernformaten zu zeigen.

Beispiel für multimodalen Content (Produktseite) bei Keyword.com

Beispiel für multimodalen Content (Produktseite) bei Keyword.com

Ein weiteres starkes Beispiel ist dieses von Superside.

Beispiel für multimodalen Content (Blog) bei Superside

Beispiel für multimodalen Content (Blog) bei Superside

Es kombiniert eine gut organisierte Mischung aus Erklärvideos, Grafikmodellen, Branded Visuals und Podcast-Clips für mehrschichtige Insights. Das ist der Content-Typ, den KI-Systeme gerne referenzieren!

Quick-Tipp: Nutzen Sie Schema-Markup (VideoObject, ImageObject, HowTo) und beschreibende Alt-Texte, damit KI-Crawler Ihre Visuals „verstehen” und nicht überspringen.

3. Bedienen Sie nuancierte, kontextuelle Intentionen und mappen Sie Content darauf

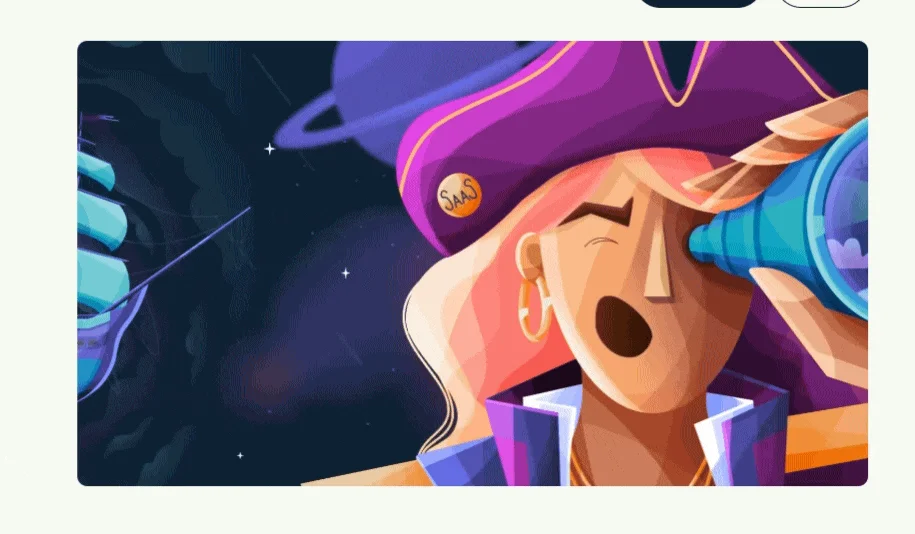

„Keyword-Recherche ist absolut nicht dasselbe wie Prompt-Recherche, weil die Intent-Bucket-Kategorien, mit denen wir früher gearbeitet haben, veraltet sind”, sagt Josh Blyskal, AEO Strategy and Research Lead bei Profound.

Er teilte Insights aus seiner Forschung: 37,5 % der Prompts auf ChatGPT haben eine neue Intention – eine generative Intention.

Screenshot eines generativen Intent-Prompts in ChatGPT

Quelle

Screenshot eines generativen Intent-Prompts in ChatGPT

Quelle

Beispiele: „Schreibe eine Kündigungs-E-Mail”, „Erstelle ein 3-Folien-SEO-Pitch-Deck”. „Nutzer kommen mit der Erwartung, dass die Answer Engine das Asset, den Text, den Code, das Bild, den Plan, den Outline – was auch immer – erstellt.”

Das heißt: Für KI-Suche gibt es geschichtete Intentionen jenseits der klassischen SEO-Intentionen (navigational, transaktional, kommerziell, informational).

Diese ersetzen die „alten” Intentionen nicht. Aber um zu konkurrieren, müssen Sie über Basis-Keyword-Intent hinausgehen und die nuancierten, zugrunde liegenden Ziele einer Anfrage verstehen.

Der beste Weg: Optimieren Sie Content über eine versteckte Bandbreite an Fan-out-Anfragen und Nutzer-Kontexten. Dann erstellen Sie tiefgehenden Content, der diesen breiteren, aber verwandten Intentionen entspricht.

Was ist ein Query-Fan-out?

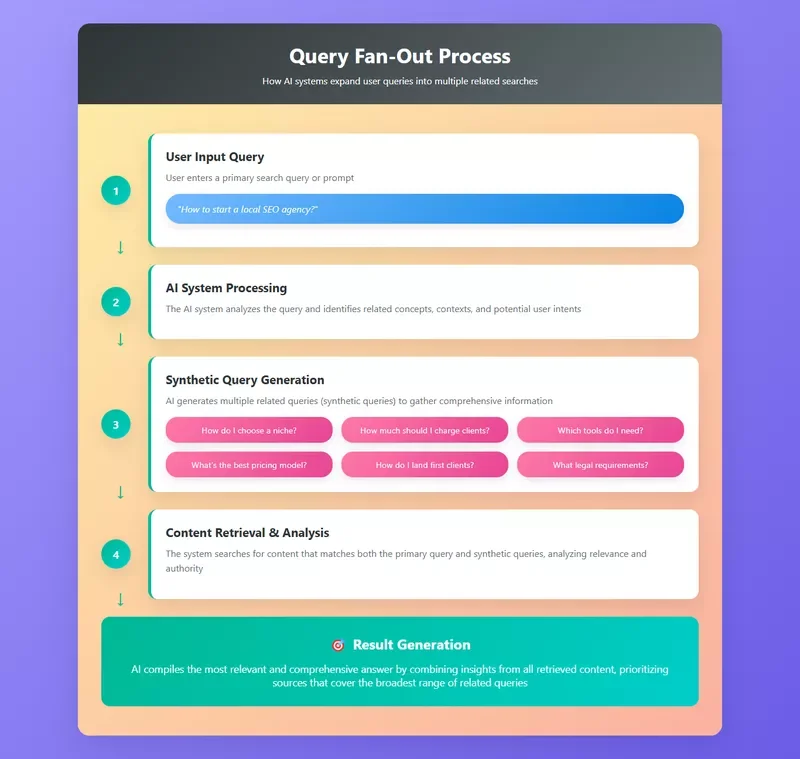

„Ein Query-Fan-out ist eine Technik von KI-Systemen, bei der eine ursprüngliche Nutzeranfrage in eine Reihe zusätzlicher, verwandter Anfragen erweitert wird – sogenannter synthetischer Anfragen”, sagt Mike King, Founder und CEO von iPullRank, in einem aktuellen Webinar.

„Statt nur das primäre Keyword zu betrachten, führen KI-Systeme im Hintergrund mehrere Suchen mit diesen synthetischen Anfragen durch, um eine breitere Bandbreite relevanter Passagen und Dokumente zu sammeln.”

So sieht das visualisiert aus:

Query-Fan-out-Flussdiagramm mit verwandten synthetischen Anfragen

Query-Fan-out-Flussdiagramm mit verwandten synthetischen Anfragen

Einfach gesagt: LLM-gestützte Suchmaschinen suchen mehr als Exact-Match-Keywords. Sie berücksichtigen primären und impliziten Kontext sowie die Personalisierung.

Sie müssen also – neben dem Ranken für ein spezifisches Keyword – auch für die Fan-out-Anfragen ranken, die KI-Algorithmen verwenden, um in KI-Plattformen entdeckbar zu sein.

Sie können einen Query-Fan-out-Simulator wie Qforia nutzen, um synthetische Anfragen für Google AI Overviews und Google AI Mode zu finden, und diesen Search-Query-Extractor für ChatGPT.

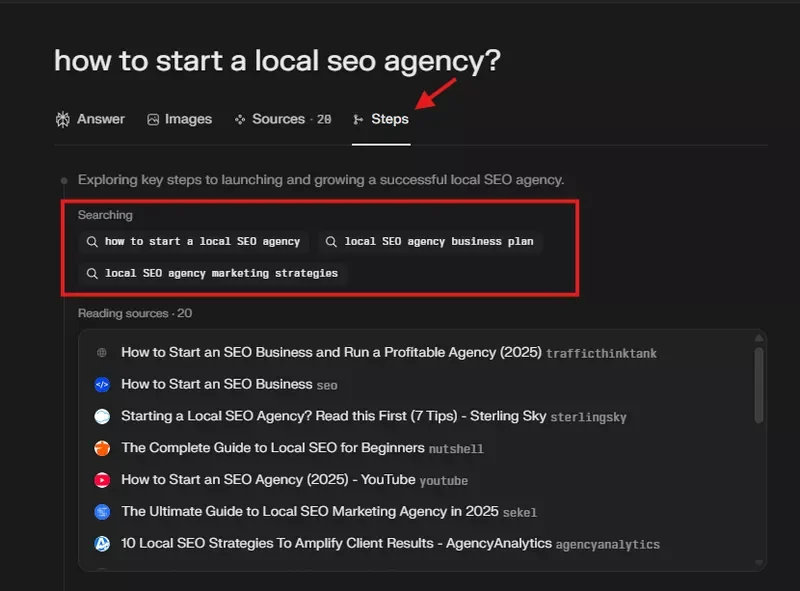

Hier ein einfacher DIY-Trick:

- Besuchen Sie Gemini oder Perplexity.

- Geben Sie Ihre Anfrage ein. Beispiel: „Wie startet man eine lokale SEO-Agentur?”

- Klicken Sie auf „Steps” (in Perplexity) oder „Show thinking” (in Gemini).

- Sie erhalten eine Liste von Anfragen oder Long-Tail-Keywords plus Quellen, die das LLM für seine Recherche genutzt hat.

Screenshot von Perplexity mit dem „Steps”-Feature für eine Anfrage – mit Fan-out-Anfragen und Quellen

Screenshot von Perplexity mit dem „Steps”-Feature für eine Anfrage – mit Fan-out-Anfragen und Quellen

Mit dieser Liste an Anfragen erstellen Sie Content rund um diese. Behandeln Sie sie aber nicht wie reguläre Keywords (Exact-Match-Input). Weben Sie sie natürlich in Ihren Content ein – als ob Sie antizipieren, was ein neugieriger Nutzer als Nächstes fragen könnte.

Den Content mappen

Für die Basis-Anfrage „Wie startet man eine lokale SEO-Agentur?” könnten Fan-outs sein:

- „Wie wähle ich eine Nische?”

- „Wie viel sollte ich Kunden berechnen?”

- „Welche Tools brauche ich?”

- „Welches Pricing-Modell ist ideal für neue Agenturen?”

- „Wie gewinne ich meine ersten Kunden?”

- „Welche rechtlichen Anforderungen sollte ich beachten?”

LLMs versuchen, dieses gesamte Spektrum zu mappen – Ihr Content sollte das auch.

So bringen Sie das in den Maßstab:

- Strukturieren Sie Content rund um konversationelle Unterthemen. Sie müssen keine Exact-Match-Phrasen sein – nur klare, relevante Header, die abbilden, was Nutzer (und LLMs) wahrscheinlich fragen. KI-Such-Plattformen belohnen Content, der wie ein Hin und Her liest, mit Absätzen, die jeweils eine Kernfrage beantworten und natürlich zur nächsten überleiten.

- Fügen Sie eine FAQ-Sektion hinzu, falls die Fragen natürlich und einsichtsreich wirken.

- Sprechen Sie zum Kontext, nicht nur zum Keyword. Eine Sektion zu Agentur-Modellen wird wertvoller, wenn Sie auch Pros/Cons, Use Cases und Entscheidungsfaktoren beleuchten.

Mit diesem Ansatz zitieren LLMs Ihren Content eher, weil er das volle Spektrum der Anfrage – inklusive Schichten, Folgefragen und Spezialfälle – „versteht”.

4. Bringen Sie Ihr technisches SEO in Ordnung

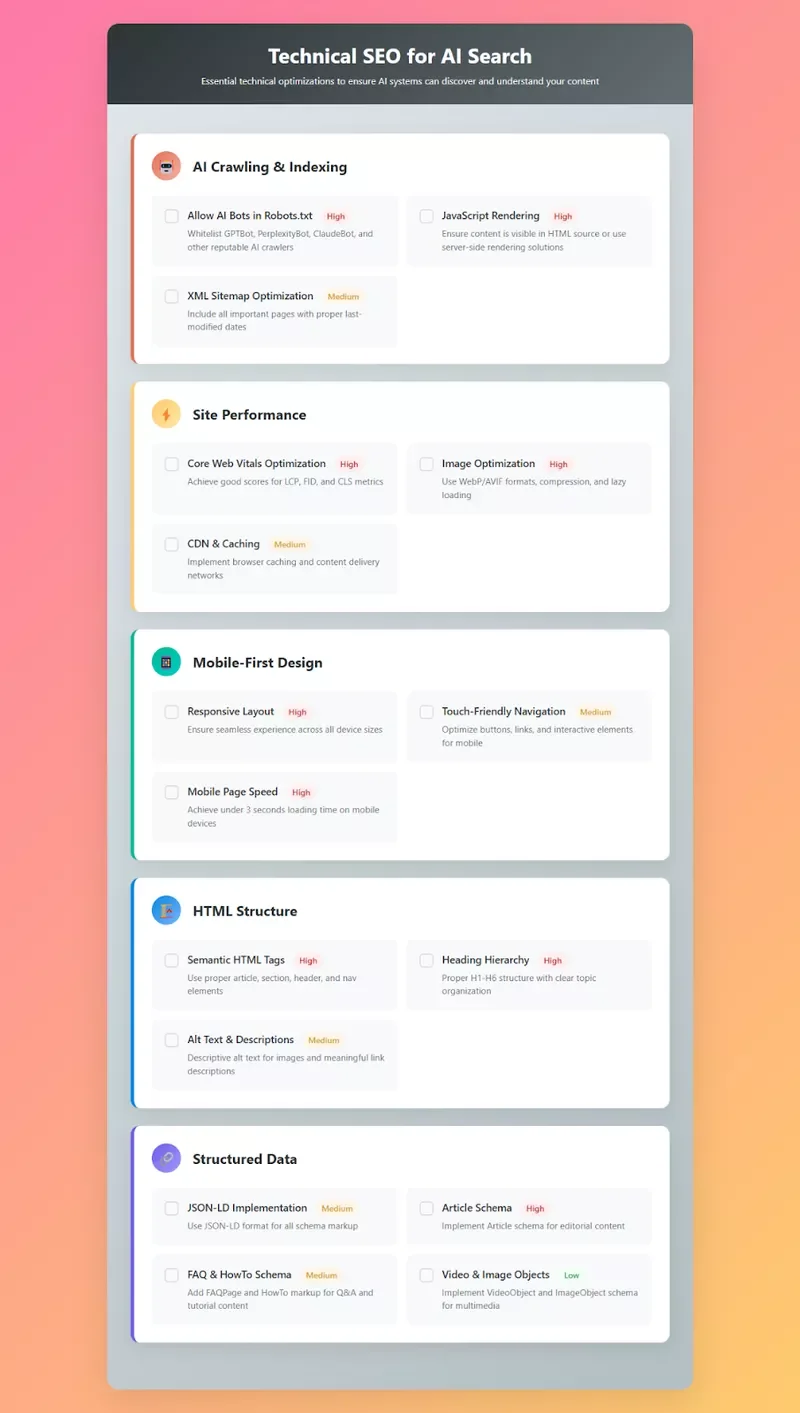

Wir haben viel abgedeckt – aber die initiale Auffindbarkeit durch KI- und LLM-Such-Systeme bleibt ein entscheidender erster Schritt zur KI-Such-Optimierung. Sie müssen die technischen SEO-Basics richtig haben, damit KI an das Gute herankommt: Ihren Content.

Praktische Maßnahmen:

Technische-SEO-Checkliste für KI-Such-Optimierung

Technische-SEO-Checkliste für KI-Such-Optimierung

Stellen Sie sicher, dass KI Ihre Site crawlen und „indexieren” kann

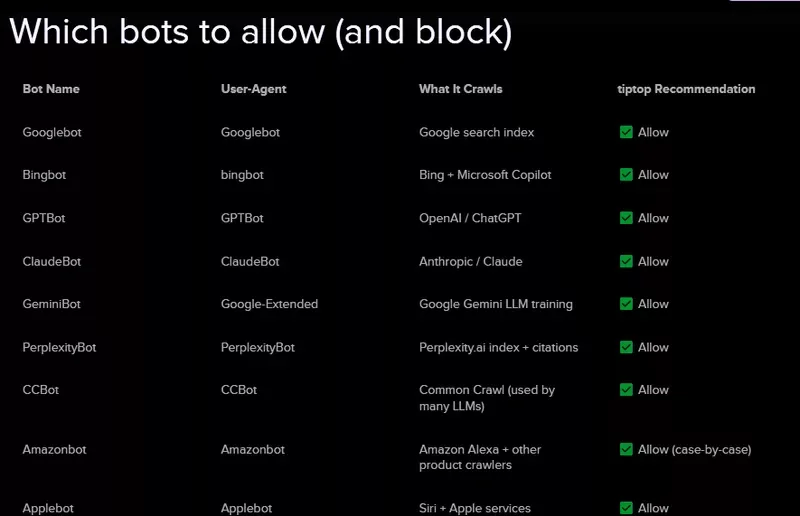

Wenn Sie KI-Bots wie GPTBot, PerplexityBot oder ClaudeBot in Ihrer robots.txt blockieren, wird Ihr Content nicht gesehen. Das heißt: Er kann nicht zitiert, zusammengefasst oder in Antworten verwendet werden.

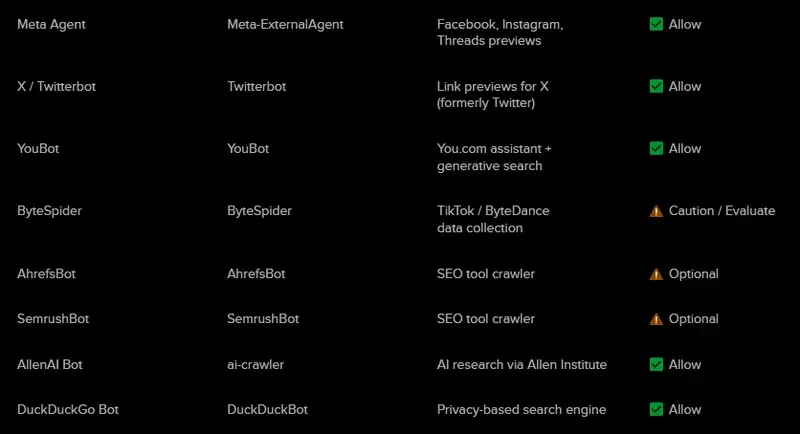

Prüfen Sie zunächst, welche Bots Zugriff haben, und whitelisten Sie die seriösen. Hier eine Liste mit KI-Bots, die Sie laut der SEO- und Marketing-Agentur tiptop erlauben (oder verbieten) können.

Quelle

Quelle

Screenshot der zu erlaubenden oder zu blockierenden KI-Bots

Screenshot der zu erlaubenden oder zu blockierenden KI-Bots

Abgesehen von Gemini und AppleBot können viele große KI-Crawler noch kein JavaScript rendern. Damit Sie in KI- oder LLM-Such-Systemen auftauchen, muss Ihr JavaScript im Klartext (HTML-Quelltext) der Seite erscheinen. Ein Tool wie Prerender.io hilft, eine indexierte Version Ihrer Seite zu generieren, damit KI-Bots Information sehen, crawlen und verstehen.

Verbessern Sie Site-Speed und Core Web Vitals

Page Speed und Core Web Vitals sind Googles UX-Metriken – sie beeinflussen aber auch, ob eine Site auf KI- und LLM-gestützten Such-Systemen sichtbar wird.

KI nutzt Ladezeit als Qualitätssignal. Schnelle Sites werden gegenüber langsamen priorisiert, weil schneller Content für eine bessere UX steht. Außerdem haben KI-Crawler Zeitbudgets – sie brechen langsam ladende Seiten ab.

So vermeiden Sie das:

- Lazy-Loaden Sie Below-the-Fold-Content.

- Komprimieren Sie Bilder (typischerweise WebP- oder AVIF-Format).

- Nutzen Sie Browser-Caching und CDNs zum schnelleren Laden.

- Tracken Sie Ihre Core Web Vitals mit PageSpeed Insights und Search Console.

Gehen Sie Mobile-First

Wenn Ihre Site nicht voll responsiv ist, kann KI sie überspringen – Mobile-Friendliness ist Teil des Bewertungsprozesses. Sorgen Sie für nahtlose Inhalte über Geräte hinweg.

Liefern Sie sauberes HTML und semantische Tags

Verwenden Sie korrekte <article>-, <section>-Tags, Überschriften, Alt-Texte und Linkbeschreibungen. KI kann eine Wand unstrukturierten Codes nicht interpretieren – aber gut organisierte und getaggte Inhalte schon.

Setzen Sie strukturierte Daten ein (Schema.org)

Strukturierte Daten via Schema-Markup erzeugen Rich Snippets, die Klicks treiben und KI-Systemen helfen, Ihren Content zu verstehen.

Klassisch verlassen sich Suchmaschinen auf strukturierte Daten zur Kategorisierung und zum Ranking. Diese liefern aber auch explizite Anweisungen, worum es auf Ihrer Seite geht – KI-Systeme können Ihren Content so leichter parsen und in Antworten zitieren.

Aber Achtung: Schema ist in generativen KI-Ergebnissen nicht immer Pflicht. Molly Katz’ Untersuchung an 100 Healthcare-Websites zeigte, dass Sites mit Schema in AI Overviews nur leicht häufiger erschienen als ohne (18,1 % vs. 16,2 %).

Schema verbessert dennoch Auffindbarkeit und Interpretierbarkeit – besonders kombiniert mit starkem Format und kontextueller Klarheit.

Für SEO- und LLM-Best-Practices nutzen Sie JSON-LD zur Implementierung. Es bettet strukturierte Daten direkt in Ihr HTML ein, ohne sichtbaren Content zu überfrachten.

Wichtige Schema-Typen:

- Article (für redaktionellen Content).

- FAQPage (für Q&A-Sektionen).

- VideoObject | ImageObject (für Video- und Bildinhalte).

- HowTo (für Schritt-für-Schritt-Anleitungen).

- Product (für E-Commerce).

Diese geben KI-Bots eine klare Karte Ihres Contents – das erhöht Ihre Zitations-Chancen in KI-Antworten.

5. Analysieren Sie Prompt-Muster und passen Sie sich an

Der wirksamste Content ist gut geschrieben und so geformt, wie Menschen denken und Fragen stellen. Das beginnt mit dem Verstehen echter Prompt-Muster. Sie müssen aber auch die gesamte Customer Journey verstehen – jede Phase erzeugt unterschiedliche Fragen, die zu wertvollen KI-Optimierungs-Prompts werden.

Denken Sie an Amateur-Prompt-Engineering für Marken.

Sammeln Sie zunächst Daten aus Ihren (oder den Kunden-)Support-Logs, Chat-Transkripten, Branchen-Foren auf Reddit, Slack und Quora oder Sales-Calls. Das nennt sich „Conversational Mining” – Sie identifizieren wiederkehrende Fragen, die Menschen natürlich stellen, nicht nur Themen-Keywords.

Beobachten Sie, wie Kunden ihre Probleme formulieren, welche Einschränkungen oder Anforderungen sie nennen und wie viel Detail sie liefern. Das sind die besten Proxys für echte Nutzer-Prompts.

Geben Sie diese in KI-Tools wie Gemini oder Perplexity ein (wie oben unter Query-Fan-out und Intent-Mapping beschrieben), um zu sehen, wie LLMs sie erweitern und interpretieren. Welche Quellen werden zitiert? Wie strukturieren sie Antworten?

Sie erkennen Trends: bestimmte Formulierungen, Formate, unerwartete Perspektivwechsel.

Wenn Sie fünf bis zehn konversationelle Prompts haben, die in Ihrer Zielgruppe häufig sind, integrieren Sie diese in Ihre Content-Strategie. Verwenden Sie sie als Sektions-Überschriften, FAQs, Beispiele oder Analogien – besonders wenn der Prompt einen „Zeig-mir-wie”- oder „Erklär’s mir wie einem 5-Jährigen”-Ton impliziert.

Streben Sie Struktur und Tonalität an, die konversationell wirken.

6. Iterieren und Verfeinern auf Basis der Ergebnisse

Sobald Ihr Content live ist: testen, beobachten, justieren, wiederholen.

Beginnen Sie damit, Prompts manuell durch Ihr bevorzugtes LLM zu schicken.

Wird Ihr Content zitiert oder zusammengefasst? Wenn nicht, ändern Sie etwas. Probieren Sie andere Headlines, überarbeiten Sie Intros oder schärfen Sie Schema.

Sie können prompt-freundliche Elemente A/B-testen – etwa einen FAQ-Block, aktualisierte Metadaten oder veränderte Passagen-Struktur. Schicken Sie den Prompt erneut und beobachten Sie Veränderungen im KI-Output.

Wenn Sie Glück haben und Nutzer-Feedback erhalten (über Chatbots, Such-Snippets oder Analytics), nutzen Sie es. Je mehr Sie verfeinern, desto besser erkennt und zeigt das KI-System Ihren Content.

Erfolg in der KI-Such-Sichtbarkeit messen

Wenn Sie das Nötige getan haben, um in Googles KI und LLMs Sichtbarkeit zu gewinnen – wie wissen Sie, dass es wirkt? Wir haben die Metriken für KI-Sichtbarkeits-Tracking in einem anderen Beitrag behandelt.

Hier einige Erfolgsindikatoren bei der Optimierung von Content für KI-Suche:

Markenerwähnungen in KI-generierten Antworten

Achten Sie darauf, wann und wie oft Ihre Marke oder Ihr Content direkt in KI-Antworten zitiert wird.

Mit dem AI-Overviews- und Visibility-Tracker von Keyword.com können Sie Markenerwähnungen und Sichtbarkeit über große KI-Plattformen wie ChatGPT, Googles AI Overviews, Perplexity und Claude überwachen.

Sie sehen außerdem, welche Anfragen diese Erwähnungen auslösen, welche Seiten in LLM-Antworten erschienen sind und welche konkreten Antworten aus dem Content gezogen wurden. Diese Insights helfen, Ihre Kampagne anzupassen und Chancen auf KI-Sichtbarkeit über Plattformen hinweg zu verbessern.

Schauen Sie dieses Erklärvideo, wie Sie die Markensichtbarkeit mit Keyword.com überwachen.

Ist Ihre Marke in ChatGPT, Perplexity & Google AI? Dieser AI-Visibility-Tracker zeigt es Ihnen!AI Share of Voice

Diese Metrik zeigt, wie oft Ihr Content oder Ihre Marke in KI-generativen Antworten zu einem bestimmten Thema im Vergleich zu Wettbewerbern erscheint. Je höher Ihr Anteil, desto mehr thematische Autorität haben Sie – besonders über Anfrage-Varianten hinweg. Mehr Autorität führt zu mehr Traffic, höherer Lead-Qualität und mehr Verkäufen.

Zero-Click-Sichtbarkeit

Similarweb berichtet, dass Seiten mit AI Overviews mittlerweile Zero-Click-Raten von 80 % haben – verglichen mit 60 % ohne KI-generierte Antworten.

Das heißt: Auch wenn Nutzer nicht klicken – in AI Overviews zitiert zu werden, in LLMs zusammengefasst zu erscheinen oder in Featured Snippets zu landen, zählt als Gewinn. Es baut Markenbewusstsein auf, signalisiert E-E-A-T und sichert Mindshare für künftige Interaktionen.

KI-vermittelter Traffic

Beginnen Sie damit, Traffic zu segmentieren und zu überwachen, der aus KI-Features stammt (über UTMs oder Custom-Event-Tracking). Die Attribution ist noch jung – aber so verstehen Sie, welcher Content Interesse nach KI-Exposition treibt.

KI-Such-Prompts mit Keyword.com tracken

Sichtbarkeit in der KI-Suche bringt nicht immer Traffic im klassischen Sinn – aber sie führt zu Einfluss, Vertrauen und letztlich zu Conversions.

Um zu tracken, wie Ihr Content in der KI-Suche performt, nutzen Sie Keyword.com. Unser AI-Brand-Monitoring-Tool zeigt Ihnen, wann und wo Ihre Marke in Googles AI Overviews, in ChatGPT, Perplexity und mehr erscheint – damit Sie ausbauen, was funktioniert, und nachjustieren, wo Sie ausgelassen werden.

Beginnen Sie zu messen, was und wo es zählt. Registrieren Sie sich, um zu starten.